AI 개발 도구

Hands-on

에이전트 · 컨텍스트 엔지니어링 · 실습

S/W개발팀 SE · 김학민 · 2026. 4

프로그램 구성

Part A 맥락 · Part B Claude Code 심화 · Part C Hands-on Labs

자동완성 → 대화 → 에이전트 → 팀

지난 1년, 개발 도구의 축이 매년 하나씩 이동했습니다

SECTION 01

시장이 말하는 것

SaaSpocalypse — SaaS(구독형 소프트웨어) + Apocalypse

SaaSpocalypse — 시장의 즉각적 반응

S&P 500 vs Software Sector(IGV) 디커플링 — 2025.10 고점 대비

하루 시총 큰 폭 하락

AI 자동화가 좌석 라이선스에 압력

직원 ≠ 라이선스

AI Agent가 사람이 직접 쓰고 판단을 내리는 도구가 되자, 중간 소프트웨어가 흔들렸습니다

제한된 기능

(피처폰)

무한한 확장성

(스마트폰)

1년 사이 모델 성능이 크게 달라져서, 예전 경험 기준으로는 현재 상황을 가늠하기 어려운 구간입니다

개발 업무 전반에 확산

기능 개발 · 리팩터링

보일러플레이트 제거

PR 리뷰 · 테스트 생성

엣지 케이스 탐색

재현 · 원인 분석

가설 경쟁

로그 분석 · 장애 대응

문서화 · 온콜 보조

단순 코드 생성이 아니라 개발 사이클 전반에 AI가 스며드는 구조

"자연어가 새로운 프로그래밍 언어가 되고 있고, 더 많은 사람이 기계와 직접 대화한다"— Jensen Huang, NVIDIA CEO

셸 명령 대신 의도로 컴퓨터를 조작하는 시대 — CLI에서 자연어 에이전트로

SECTION 02

업계 기준선

지금 어디까지 와 있는가

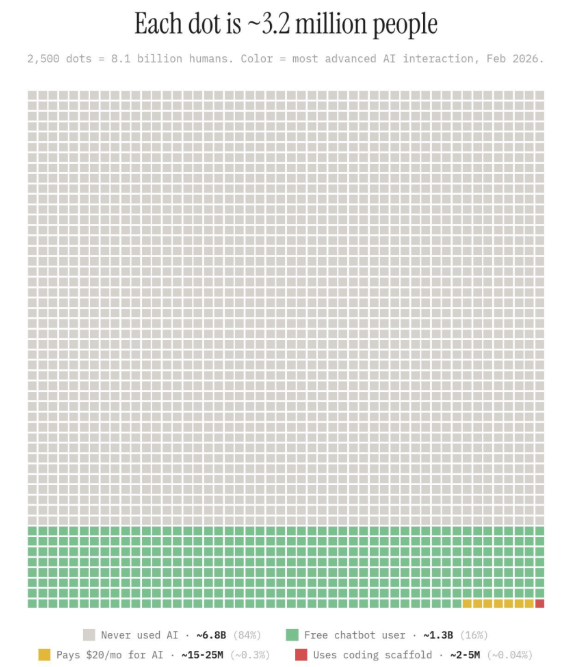

AI 사용자 규모 — 점 하나가 120만 명

전 세계 AI 도구 사용자 분포

수억 명

극소수

매우 소수

AI를 들어본 사람은 많지만, 에이전트를 직접 써본 사람은 거의 없습니다

핵심 지표

개발자 세계에서는 이미 표준 — 다음 차례는 모든 직군

변화의 속도

2년 만에 자동완성에서 멀티에이전트까지

SECTION 03

Model ≠ Agent

같은 모델이어도 어떤 에이전트 위에서 구동하느냐로 결과가 달라진다

패러다임 전환 — CLI → GUI → 챗봇 → 자율 에이전트

인터페이스의 축이 지시에서 위임으로 이동

콜센터 ARS vs 전담 비서

챗봇과 에이전트의 주요 차이

ARS (챗봇)

1번 누르세요, 2번 누르세요

정해진 메뉴 바깥은 불가

매번 처음부터 다시 설명

전담 비서 (에이전트)

맥락을 이해하고 알아서 조사

판단 · 실행 · 중간 보고

피드백 반영 · 후속 조치까지

기본 챗봇 경험과 에이전트 경험은 구조적으로 다른 체험이라, 한쪽으로는 다른 쪽을 가늠하기 어렵습니다

대답하는 도구 → 일하는 도구

| 챗봇 (ARS) | 에이전트 (비서) | |

|---|---|---|

| 환경 인식 | 주어진 정보만 참조 | 프로젝트의 전체 맥락 이해 |

| 실행 능력 | 텍스트 답변만 가능 | 문서 작성 · 분석 · 도구 실행 |

| 작업 범위 | 1회 질의-응답 | 수시간 자율 실행 · 중간 보고 |

| 오류 대응 | 다시 지시해야 함 | 자체 감지 → 수정 → 재시도 |

비유로 이해하는 구조

같은 모델이라도 어떤 에이전트 위에서 구동하느냐에 따라 결과가 달라집니다

성능 공식

성능 = Model × Agent × 나(Pilot)

AI의 추론 능력

Claude, GPT, Gemini

도구 사용·실행 능력

Claude Code, Codex

판단·지시 능력

도메인 지식, 프롬프트

셋 중 하나라도 0이면 결과도 0 — 사용하는 사람이 핵심

에이전트에서 팀(Team)으로

비서 1명에서 전문가 팀으로 확장

에이전트 1명

Solo · Sequential

순차 처리

시장조사

보고서

팩트체크

시각화

한 명이 순서대로 처리하던 일을 팀이 동시에 — 개인 작업에서 조직 작업으로

에이전트는 지시 → 실행 → 결과 구조입니다

사람이 매 단계 개입하지 않습니다

실제 에이전트 — Claude Code

코딩 에이전트가 아니라, 파일을 열고 수정하고 실행하는 자율 에이전트

앱 · 웹사이트

자동 생성

작성한 코드를

직접 실행 · 검증

보고서 · 발표자료

구조화 · 작성

데이터 수집

인사이트 도출

코딩뿐 아니라 문서 · 분석 · 발표자료 같은 디지털 산출물 전반에 적용

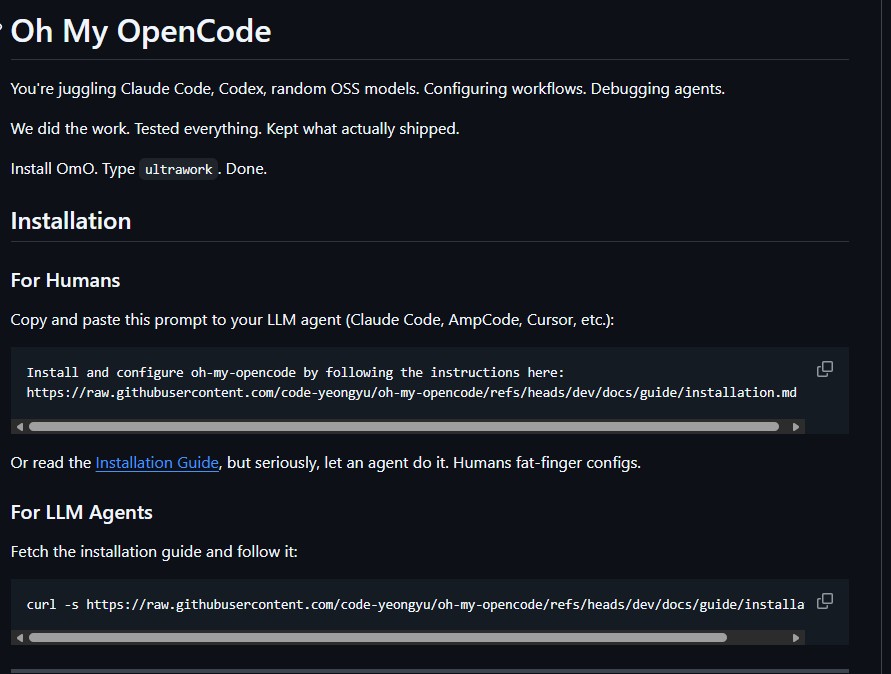

이미 일어난 변화 — GitHub README가 사람과 에이전트용으로 분기

출처: GitHub — Oh My OpenCode README

For Humans

"이 설치 프롬프트를 LLM 에이전트에게

복사해서 붙여넣으세요"

For LLM Agents

curl -s 로 가이드를 직접 가져와

각자 환경에 맞춰 실행하세요

"사람이 직접 설치하면 오타낸다. 에이전트한테 시켜라."

문서의 독자가 사람만이 아닌 것은 이미 오픈소스의 현실

"AI가 구현을 대신할수록,— Addy Osmani, Google · Agentic Engineering

아키텍처 사고와 보안 인식의 가치는 오히려 더 높아진다"

시스템 설계 · 도메인 이해 · 품질 검증 역량이 상대적으로 더 중요해짐

에이전트 확산은 인프라 수요를 끌어올립니다

토큰 소모 수 배~수십 배 → 메모리·네트워크·전력이 가장 먼저 움직임

SECTION 04

AI 인프라의 병목

에이전트 확산이 어디에 압력을 만드는가

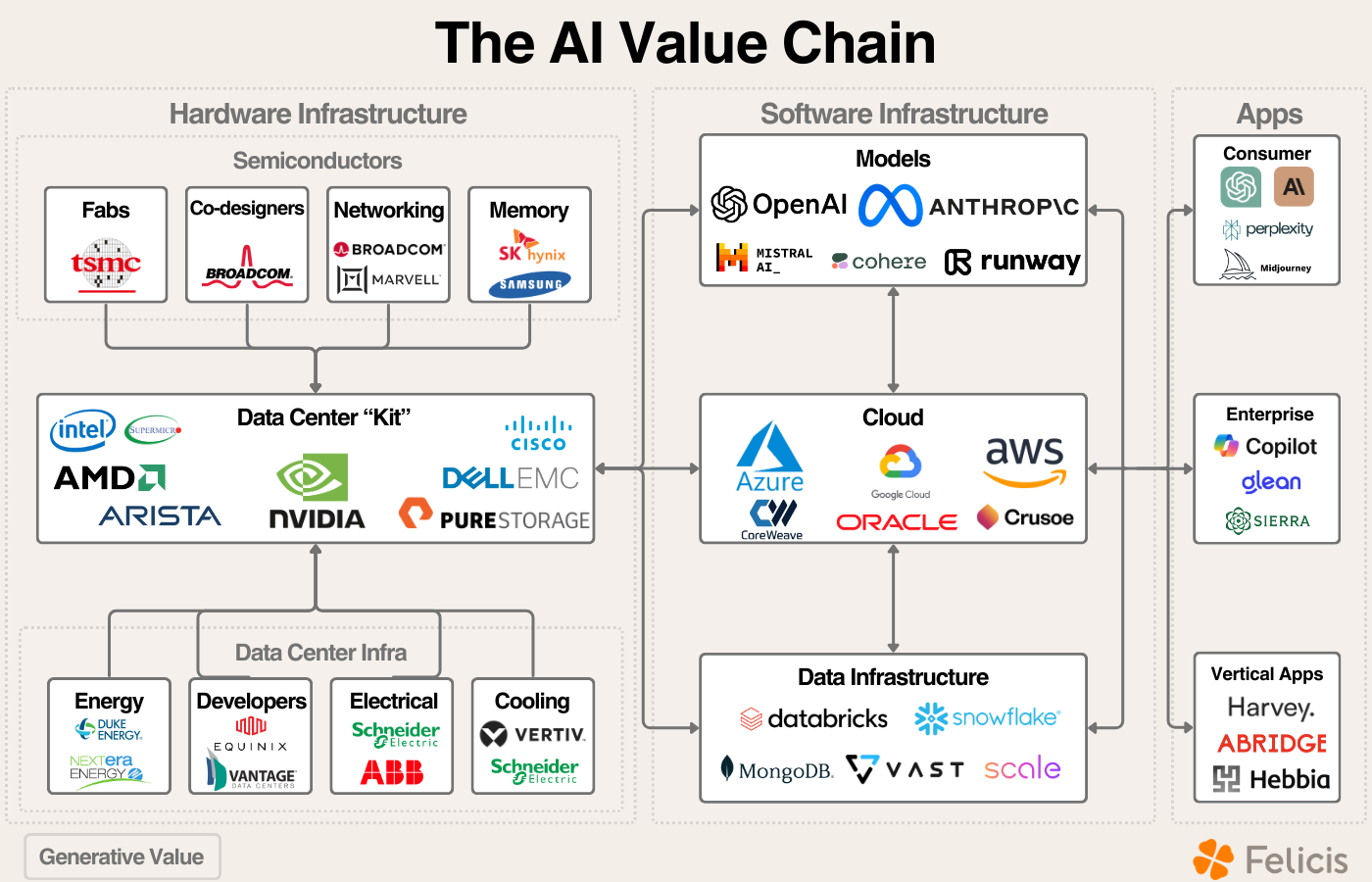

AI 밸류체인 — 레이어 전체 지도

출처: Machine Learning Made Simple — Investor's Analysis of the Gen AI Market

반도체 · 데이터센터 · 클라우드 · 모델 · 애플리케이션 — 이 중 어디에 먼저 압력이 쌓일지 함께 살펴봅시다

수요 증가가 가장 먼저 닿는 곳

훈련 · 추론 · 영상 · 월드모델 — 수요 패턴이 메모리 쪽으로 수렴하는 양상

텍스트 LLM보다 추론·영상·월드모델 쪽이 훨씬 빠르게 자원을 소모 — 로직 칩보다 HBM 공급 측 여유가 출고량에 더 크게 영향

AI Agent 시대 = 추론 상시화 시대

에이전트가 늘어날수록 — 추론 연산 × 저장 수요 = 메모리 수요

왜 천문학적 투자를 멈출 수 없는가

과잉투자는 비용의 문제, 과소투자는 존재의 문제

향후 10–15년 AI 플랫폼 재편 국면에서 포지션을 놓칠 가능성

— 빅테크 CEO 공개 발언 종합

과소투자 리스크가

과잉투자보다 극적으로 크다

— Sundar Pichai, Alphabet CEO

수요 > 공급, 긴 리드타임

지금 안 깔면 따라잡을 수 없음

— AI 클라우드 점유율 게이트

“I am willing to go bankrupt rather than lose this race.” — Larry Page, Google 공동창업자

메모리 · 스토리지 — AI 서버의 주요 구성 요소

GPU 위에 직접 적층, AI 연산 속도의 최대 병목

CPU 시스템 메모리, 에이전트 세션 · KV-cache 오프로드

학습 데이터 · 모델 저장, 에이전트 파일 I/O 경유

레거시 서버 · 산업용, HBM 확대로 공급 감소 → 동반 상승

공급·수요 구조

같은 웨이퍼 라인 공유

HBM 확대 → 범용 DRAM·NAND 캐파 경쟁

에이전트 전환으로

토큰 소모 수 배~수십 배

같은 사용자 수여도 인프라 소모 폭증

HBM · DDR5 · NAND

동반 상승

리드타임 장기화

GPU 수요가 커질수록 메모리 수요도 함께 따라가는 구조

SECTION 05

역할의 변화

구현에서 설계 · 판단으로

구현 비용의 붕괴

"코드 작성은 점점 값싼 상품이 되고 있고, 정말로 중요한 것은 어떤 질문을 할 수 있느냐"— Jensen Huang, NVIDIA CEO

기획자 : 실행자 비율의 역전

기획 : 실행

1 : 7

기획 : 실행

2 : 1

실행 시간이 3주 → 1일로 압축되면서, 기획과 판단의 비중이 더 커지고 있습니다

도메인 전문성과 AI의 결합

범용적이지만

깊이 부족

깊지만

속도 제한

깊이 + 속도

= 차별화된 결과물

도메인 경험과 AI가 결합될 때 차별화된 관점이 만들어지기 쉽습니다

인지 노동의 심화

AI 산출물을 확인하고

맥락·판단을 더하는

사람 쪽 작업

AI가 빨라질수록, 다음 결정을 내리는 사람이 critical path

AI는 증폭기(Amplifier)

효과 가속

문제 악화

AI는 마법이 아닌 증폭기 — 기반이 좋으면 가속, 아니면 혼란도 가속

AI의 한계 — 환각(Hallucination)

존재하지 않는 데이터를

자신 있게 생성

보고서에 가짜 출처

틀린 수치가 포함될 수 있음

AI 산출물은 반드시

사람이 검증

AI가 만든 것을 그대로 쓰는 것이 아니라 검증하고 판단하는 것이 핵심

개발자 역할은 어떻게 변하는가?

키보드 타격 시간은 줄고 — 판단·검증의 밀도가 올라간다

생산성의 역설과 도파민 루프

AI가 일을 해준다고 사람이 편해지는 것은 아닙니다

인지 소진 — 실천적 대응

도구가 빨라졌다고 사람도 빨라져야 하는 것은 아닙니다

SECTION 06

현실 제약과

실천 방향

기술 가능성과 우리 환경의 적용 가능성은 별개의 문제

기술 가능성과 적용 가능성의 분리

| 기술적으로 | 우리 환경에서 | 예시 | 대응 | |

|---|---|---|---|---|

| A | 가능 | 적용 가능 | 외부 AI로 시장 분석 · 보고서 초안 · 번역 | 즉시 시작 |

| B | 가능 | 제약 존재 | 사내 데이터 분석 · 내부 시스템 연동 | 제약 해소 추진 |

| C | 불가 | 해당 없음 | 100% 자율 의사결정 | 기술 성숙 관찰 |

A는 오늘부터 가능 · B는 논의의 여지 · C는 기술 성숙도를 지켜보는 영역

우리 환경의 제약

S/W 개발팀이 현재 진행 중인 사항

DS부문 차원의

AI 도구 적극 활용 방침

공통 인프라 조직과

메모리사업부 SW조직

외부 AI 도구 활용

개발 효율화 PoC 진행

전사 의지 · 협업 기반 · 선행 PoC — 실행 궤도에 이미 올라 있음

PART II

Claude Code

Hands-on

도구 · 워크플로 · 작동 원리

Claude Code — 무엇인가

코딩 도구가 아니라 파일 시스템 위에서 작동하는 에이전트 — 범용 작업 인터페이스

주요 AI 개발 도구 비교

| 도구 | 형태 | 기본 모델 | 특징 |

|---|---|---|---|

| Claude Code | CLI + IDE | Claude (Opus/Sonnet/Haiku) | 에이전트 루프 · Skills · Teams |

| Codex CLI | CLI | GPT-5 계열 | 리뷰 · 병렬 검증에 강점 |

| Cursor | IDE 전용 | 멀티 (Claude/GPT/Gemini) | 에디터 UX 완성도 |

| Continue | IDE 확장 | 로컬/원격 선택 | 오픈소스 · 커스텀 자유도 |

오늘은 Claude Code 중심으로 다룹니다 — 다른 도구는 필요에 따라 병행. 도구는 자주 바뀌지만 에이전트 작동 원리는 공통

설치 · 첫 실행

# 설치 npm install -g @anthropic-ai/claude-code # 실행 (프로젝트 루트에서) cd your-project claude # 인증 OAuth 로그인 또는 API 키

Node.js 18.18+

Git 2.30+

사외망 환경에서 프론티어 모델 사용

사내망 가이드는 별도 공지

"이 레포 구조를 요약하고 CLAUDE.md 초안을 만들어줘"

Agent Loop — 에이전트는 이렇게 작동한다

챗봇은 1회 응답, 에이전트는 이 루프 자체가 메커니즘

Tool Use — 무엇을 할 수 있나

Read 파일 읽기 · Edit 수정 · Write 생성Bash 셸 실행 · Grep 검색 · Glob 패턴WebFetch · WebSearch

GitHub / Jira / Slack 연동

Chrome 브라우저 자동화

DB 쿼리 · 내부 API

필요에 따라 등록

독립 컨텍스트에서 병렬 실행

대규모 탐색 · 교차 검증

메인 세션 컨텍스트 보호

자주 쓰는 절차를 한 단어로

이벤트 기반 자동 트리거

팀 단위로 공유 가능

Plan Mode · 핵심 명령어

| 명령 | 용도 | 언제 쓰나 |

|---|---|---|

/plan | 실행 전 계획만 제시 | 3파일 이상 변경, 설계 판단 필요 |

/compact | 대화를 요약으로 압축 | 긴 세션 진입 전, 컨텍스트 포화 예상 |

/clear | 컨텍스트 초기화 | 무관한 작업 전환 |

/resume | 드롭된 세션 복구 | 연결 끊김 / 재시작 |

/mcp | MCP 서버 관리 | 외부 도구 연결 |

/fast | 빠른 출력 모드 | 간단한 쿼리, 빠른 이터레이션 |

Plan mode는 의사결정이 있는 작업에서 특히 유용 — 에이전트의 판단 근거를 먼저 본다

컨텍스트 관리 — /compact vs /clear

대화 요약을 컨텍스트로 유지

맥락 보존하며 토큰 감량

완전 초기화

새 주제로 전환

프롬프트 캐시 TTL 5분

연속 사용이 비용 효율

긴 작업은 2시간 단위로 세션 리셋 — 컨텍스트가 얇아지면 판단 품질이 떨어진다

Sub-agent · 위임 임계값

| 상황 | 처리 | 이유 |

|---|---|---|

| 2 파일 수정 | 메인 세션 | 컨텍스트 오버헤드가 더 큼 |

| 순차 단계 작업 | 메인 세션 | 병렬화 이득 없음 |

| ≥10 파일 탐색 | Explore 서브에이전트 | 메인 컨텍스트 보호 |

| ≥3 독립 작업 | 병렬 Task 호출 | 시간 단축 · 격리된 실행 |

| 리서치 / 의사결정 | 리서치 fan-out | 다각도 perspective 필요 |

3명 팀 = 순차 실행 대비 3~4배 토큰 — 실제 병렬 이득이 있을 때만 붙여라

CLAUDE.md — 프로젝트 지식을 코드처럼 관리

~/.claude/CLAUDE.md<repo>/CLAUDE.md.claude/settings.local.json세션 시작 시 자동 로드 — AI가 맥락을 찾느라 허비하는 시간을 없앤다

Rules — 규칙을 모듈로 쪼개라

agent-teams.md언제 서브에이전트 띄울지, 모델 티어 선택

coding-standards.md스타일 · 테스트 · 커밋 메시지 규칙

memory.mdauto-memory 레이어 동작 방식

monitoring.mdMonitor tool 활용 패턴

단일 CLAUDE.md 거대화 → @-import로 모듈 로드, 필요할 때만 펼침

Auto-memory — 세션을 넘는 기억

역할 · 선호 · 지식 수준

교정 · 확인된 판단 + Why

현재 이니셔티브 · 마감 · 이해관계

외부 시스템 포인터 (Jira, Confluence)

~/.claude/projects/<name>/memory/MEMORY.md 인덱스 + topic 파일 — 200줄/25KB 자동 로드

Skills — 반복 절차를 한 단어 명령으로

# 사용 /review-pr 1234 # 내부 동작 (스킬 정의) 1. gh pr view 1234 2. 변경 파일 분석 3. 프로젝트 컨벤션 적용 4. 리스크 항목 요약 5. Codex 교차 검증 병렬

프롬프트 반복 제거 · 품질 일관성

레포에 커밋 → 팀원이 즉시 동일 결과

Prompt Caching — 5분 TTL의 경제학

큰 CLAUDE.md + Rules + 레포 요약이 시스템 프롬프트로 들어가면 cache 히트율이 품질과 비용을 동시에 잡는다

Agent Teams — 팀 단위 조정

| 도구 | 역할 |

|---|---|

TeamCreate | 조정된 팀 생성 · 팀원은 CLAUDE.md / Skills 상속, 대화는 상속 안 함 |

SendMessage | 팀원 간 peer-to-peer 메시지 (mailbox) |

TaskCreate / List / Get | 공유 큐 · TaskCreated hook fires |

EnterWorktree | 팀원별 분리된 브랜치 + 작업 디렉토리 |

Teams는 팀원끼리 대화가 필요할 때 — 독립 쿼리 팬아웃은 Agent 호출 여러 개로 충분

Tiered Model — 작업에 맞는 모델 티어

메인 오케스트레이션

복잡한 설계 · 합의

집중 구현 · 리뷰

목적 있는 리서치

읽기 전용 탐색

간단 lookup

Explore 에이전트가 이미 사용

Plan 모드(opusplan) — Opus가 설계 후 Sonnet으로 전환 실행

Codex Plugin — 크로스 엔진 검증

| 명령 | 용도 |

|---|---|

/codex:review | 현재 diff 또는 브랜치 read-only 리뷰 |

/codex:adversarial-review | 가정을 공격하는 데빌즈-애드버킷 리뷰 |

/codex:rescue | 복잡한 버그 / 리팩토링을 Codex에 완전 위임 |

--background | 비동기 실행, /codex:status로 폴링 |

Claude와 Codex를 동시에 다른 각도로 돌리면 한쪽 엔진의 편향을 상쇄한다

Sub-agent Fan-out — 리서치·의사결정 때만

10+ 각도로 연구 질문 탐색

아키텍처 결정 전 카운슬

광범위 산업 사례 수집

10~20 서브에이전트 동시 실행

단일 파일 버그 수정

타겟 코드 리뷰

순차적으로 엮인 구현

토큰 · 컨텍스트 폭증

20~50 워커 팬아웃은 research / decision / council에서만 정당화된다

MCP — Model Context Protocol

Claude Code, Cursor, Codex 등 여러 에이전트가 같은 MCP 서버를 공유 가능

실전 MCP — 많이 쓰는 서버

claude-in-chrome

탭 제어 · 페이지 읽기 · JS 실행

스크린샷 GIF

Codex CLI를 MCP 서버로 등록

교차 검증 · 리뷰 호출codex mcp-server

GitHub / GitLab / Jira

Slack / Gmail / Calendar

사내 API (별도 서버 구현)

필요한 도구가 MCP 서버로 이미 있을 가능성이 높다 — 먼저 탐색

설정 — .mcp.json과 Deferred Tools

{

"mcpServers": {

"codex": {

"command": "codex",

"args": ["mcp-server"]

},

"chrome": {

"command": "npx",

"args": ["@anthropic/claude-in-chrome"]

}

}

}

필요할 때만 스키마 로드 — 시작 컨텍스트 절약

키워드나 select:Name으로 필요 툴만 활성화

결과물을 고치지 말고

생성기를 고쳐라

AI 산출물을 매번 손보는 대신 프롬프트 · Skill · 규칙을 개선 — 이후 모든 산출물이 함께 나아진다

TDD + Claude Code — 테스트 먼저

테스트가 사양이자 에이전트 자율 작업의 종료 조건 — 불분명한 지시 제거

PR 리뷰 — 두 엔진 병렬

로직 정합성

프로젝트 컨벤션 일치

테스트 커버리지

보안 체크 (OWASP)

엣지 케이스 탐색

성능 리스크

가정을 공격

설계 결정 스트레스 테스트

세 리뷰 결과를 메인 에이전트가 합성 — 겹치는 항목은 high-confidence

디버깅 — 가설 경쟁 패턴

/plan으로 증상 재현 계획/codex:rescue --background 독립 재현git bisect + AI 해석으로 커밋 특정"이 버그 고쳐줘" 한 줄보다 재현 조건 + 가설 경쟁이 훨씬 효율적

Git Worktree — 병렬 브랜치 작업

# 새 worktree git worktree add ../feat-x feat-x # 또는 Agent Team에서 EnterWorktree({branch:"feat-x"}) # 정리 ExitWorktree({keepBranch:true})

팀원마다 격리된 디렉토리

메인 브랜치 오염 방지

worktree isolation 플래그가 때때로 무시됨 — 실제 경로 확인

프롬프팅 — 네 가지 베이스 패턴

"X를 읽고 Y 관점에서 요약"

읽기 + 구조화

"이 컨벤션을 따라 Z 만들어"

참조 + 산출

"A에서 B 형식으로 재구성"

입출력 명시

"이 절차를 스킬로 등록"

재사용 공정화

바로 시키지 말고 "먼저 조사해줘" — 컨벤션 파악부터 시키면 품질이 다르다

교차 검증 — AI가 AI를 검증

같은 가설을 세 엔진이 동의하면 신뢰도 급상승, 엇갈리면 반드시 사람 판단

리서치 위임 — 의사결정 전 카운슬

스코프된 질문

Sonnet 기반 합성

8~10 FAST + 3 DEEP

큰 결정 · 산업 스캔

10 관점 동시 수집

합의 vs 반대 지점 추출

리서치는 메인 컨텍스트 밖에서 — 결과 요약만 받아 토큰 예산 절약

Harness — 결과물이 아닌 생성기의 구성

| 구성 요소 | 역할 | 스코프 |

|---|---|---|

| CLAUDE.md | 프로젝트 규칙 · AI 행동 정의 | per-repo |

| Custom Skills | 반복 작업을 한 단어 명령으로 | per-repo / global |

| Rules & Memory | 페르소나 · 세션 간 기억 | global · per-project |

| Agent Teams | 하위 에이전트 병렬 · 역할 분담 | runtime |

| Hooks · MCP | 이벤트 자동화 · 외부 도구 연결 | per-repo / global |

남의 Harness보다 내가 쌓은 Harness — 만드는 과정이 곧 숙련

Hooks — 이벤트 훅으로 Claude를 길들인다

도구 실행 직전 — 위험한 Bash 차단, 특정 경로 쓰기 방지, 사전 검증

사용자 입력 직후 — 프롬프트 증강, 자동 컨텍스트 주입, 팀 컨벤션 강제

도구 실행 후 — 포매터 자동 실행, 테스트 자동 트리거, 로그 기록

세션 종료 시 — 알림, 상태 체크포인트, 남은 TODO 리마인드

// ~/.claude/settings.json

{"hooks": {

"PreToolUse": [{"matcher":"Bash","hooks":[{"type":"command","command":"./guard-bash.sh"}]}],

"PostToolUse": [{"matcher":"Write|Edit","hooks":[{"type":"command","command":"prettier --write $CLAUDE_FILE_PATHS"}]}]

}}

Claude가 한 번에 하나씩 따르는 규칙 → 훅은 자동 집행 — 지침과 행위의 간극을 메운다

Monitor tool — 폴링 대신 이벤트 스트리밍

while true; do npm run build sleep 30 done

idle 상태에도 토큰 소모, 실시간성 X

Monitor: npm run dev

→ stdout 한 줄마다

task-notification 이벤트 발생

실제 스트리밍 될 때만 깨어남 — 대기 비용 0

쓰는 곳 — 개발서버 에러 감시, 로그 tail, CI 완료 대기, 긴 빌드, 테스트 스위트 첫 실패 캐치. 한 번 샷 "끝날 때까지 대기"는 Bash run_in_background로 충분.

/loop + ScheduleWakeup의 heartbeat 폴링이 아닌 외부 사건이 주도하는 흐름

Commands — 자주 쓰는 슬래시 명령

/help — 명령 목록·도움/plan — 실행 전 계획만/compact — 대화 요약 압축/clear — 컨텍스트 초기화/resume — 세션 복구/mcp — MCP 서버 관리/fast — 빠른 응답 모드/codex:review — Codex 교차 리뷰/codex:rescue — Codex에 위임/chrome — 브라우저 자동화Custom 명령은 ~/.claude/commands/*.md에 정의 — 팀과 공유 가능

~/.claude — 파일 구조

~/.claude/ ├── CLAUDE.md # 글로벌 프로필·원칙 ├── settings.json # 권한·env·hooks ├── keybindings.json # 단축키 ├── rules/ # 모듈형 규칙 @-import │ ├── agent-teams.md │ ├── coding-standards.md │ └── memory.md ├── commands/ # Custom 슬래시 명령 ├── skills/ # 재사용 절차 ├── agents/ # 커스텀 서브에이전트 └── projects/<name>/memory/ # auto-memory

버전 관리 가능 (private repo) — 개인 Harness의 체계화

비용 · Rate Limit · 모델 티어

Rate limit 윈도: 5시간 · 7일 — 플랫폼 statusline에서 used_percentage · resets_at 확인. 3-teammate 팀은 3~4배 토큰 소모, 예산과 맞춰 운영

Eval · CI — 재현 가능한 품질 게이트

프롬프트 = 코드 — 테스트 있는 코드만 프로덕션

실전 체크리스트 — 운영에 들어가기 전

CLAUDE.md 정리 · Rules 모듈화

API 키 · 인증정보 레포 밖 격리

settings.json 권한 명시 · bypass 금지

에이전트 실행 로그 수집 · 재현성

프로젝트별 토큰 예산 · 알람

모델 다운 시 대체 경로 · manual 모드

파괴적 작업은 확인 · 승인 게이트

잘 되는 프롬프트·Skill 팀 레포에 커밋

MCP가 읽는 외부 데이터 (PR 본문 · 이슈 · 웹페이지) 에 악의적 지시 포함 가능 — untrusted input으로 간주, 민감 작업은 별도 확인 게이트

PART III

Hands-on

Labs

4개 실습 · 직접 해보기 · 해본 것으로 바꾸기

오늘의 Lab 4개

각 Lab 끝에 막히면 옆자리와 공유 · 꼭 결과를 저장해 둘 것 (다음 Lab에서 재활용)

Lab 0 · 일단 그냥 해보기

바이브코딩 x 클로드 코드 카카오톡 커뮤니티 로그 (627+명)를 Claude Code에 던져서 심층 분석 HTML 리포트를 받는다. 프롬프트 한 번 → 차트 포함 리포트 한 편

assets/labs/data/

KakaoTalk_20260415_2227_12_010_group.txt

프롬프트 붙여넣기 → 기다리기 → 결과 비교

result/ 폴더에 단일 HTML 리포트

Lab 0 · 프롬프트 — 그대로 붙여넣기

assets/labs/data/KakaoTalk_20260415_2227_12_010_group.txt 파일을 읽고 심층 분석해줘. 바이브코딩 x 클로드 코드 카카오톡 오픈채팅 커뮤니티 로그야. [기본 통계] 메시지/참여자/활동 기간 · 시간대별 활동 · Top 15 참여자 [AI 도구 생태계] 언급된 도구 Top 15 · 맥락(긍/부/비교) · 조합 패턴 [업계 트렌드] 키워드 · 날짜별 화제 · 주목 받은 기능/업데이트 (대화 인용) [실전 인사이트] 개발자 문제점 Top 10 · 유용 팁 · 비개발자 사례 결과를 HTML 보고서로 만들어줘. - 다크 테마, 모던 디자인, 외부 라이브러리 없이 CSS로 차트 - 인용은 인용 블록, result/ 폴더에 저장하고 브라우저에서 열어줘

완성되면 옆자리와 비교 — 같은 프롬프트 · 다른 리포트가 나온다. 왜 다른지가 오늘 핵심

Lab 1 · 웹 리서치 — 논문급 리포트

주제 하나 골라서 · 웹 검색 · 분석 · HTML 리포트

이란-미국 전쟁, 언제까지 진행될까?

NVIDIA Vera Rubin 아키텍처와 반도체 업계 영향

SSD의 미래와 HBM — AI 시대 스토리지 전환

삼성전자 주가, 얼마까지 갈까?

본인 업무/관심 분야 — 진짜 궁금한 것으로 해야 결과물의 품질을 판단할 수 있다

Lab 1 · 리포트 품질 올리기 — 3가지 방법

"증권가 애널리스트 리포트 스타일로 다시 — 목표가 · 투자의견 · 리스크 요인 포함"

구글에서 마음에 드는 리포트 URL을 찾아서

"이 리포트 느낌으로 만들어줘: [URL]"

"차트 3개 추가" · "executive summary 맨 위" · "출처 각주로 정리"

반드시 저장! — Lab 2에서 이 리포트를 Skill의 원본으로 사용합니다

Lab 2 · Skill Builder — 결과물이 아닌 공장

Lab 1에서 좋은 리포트를 한 번 만들었다 — 다른 주제로 또 하려면 프롬프트부터 다시

주제만 바꿔서 같은 품질의 리포트를 무한히 찍어낸다 — /research-report 한 줄

원칙: 좋은 결과가 나오면 그 재현 가능한 형태로 고정시켜라 — 프롬프트 → Skill → 팀 공유

Lab 2 · 만들고 · 돌리고 · 개선하기

/skill-creator

Claude Code 내장 스킬 — 추가 설치 불필요

방금 만든 리포트의 구조/스타일을 분석해서 /research-report Skill로 만들어줘 — 주제 입력 → 웹 검색 → HTML 자동 생성

/research-report

주제: "TSMC 3nm 양산 현황" · "AI 에이전트 시장 2026 전망"

Skill 파일 위치 — 개인: ~/.claude/skills/이름.md · 프로젝트: 프로젝트/.claude/skills/이름.md. 이 파일 하나 수정하면 앞으로 모든 리포트에 반영

Lab 3 · 자유 실습 — 3가지 트랙

Backlog / In Progress / Review / Done · 드래그앤드롭 · 우선순위 색상 · LocalStorage · 단일 HTML

스킬 매트릭스 · 리스크 히트맵 · 기술 로드맵 타임라인 · 주간 회의 안건 — 내가 진짜 쓸 것

Lab 2의 /research-report로 다른 주제 3~5개 연속 돌려보기 — 공장이 잘 돌아가는가 검증

핵심은 트랙 선택이 아니라 막혔을 때 어떻게 풀어나가는지 — 옆자리와 프롬프트를 공유하세요

Lab 회고 — 가져갈 한 가지씩

"이게 이렇게 된다고?" 싶었던 순간 하나

프롬프트를 몇 번 고쳤나 · 뭘 바꾸니 풀렸나

오늘 만든 Skill/도구 중에 내 워크플로에 붙일 것 하나

잘 되는 프롬프트 · Skill — 팀 레포에 커밋

Today’s Takeaway

- 1. Model ≠ Agent — 에이전트 위에서 모델 성능이 달라진다

- 2. Agent Loop: 지시 → 계획 → 도구호출 → 관찰 → 반복 — 기본 메커니즘

- 3. CLAUDE.md · Rules · Skills · Memory — 컨텍스트 엔지니어링이 품질의 축

- 4. 결과물이 아닌 생성기를 고쳐라 — Harness 체계화

- 5. Claude · Codex · Gemini 교차 — 독립 엔진의 합의가 신뢰도

- 6. 아키텍처 사고 · 보안 인식 · 도메인 판단 — 사람의 가치가 올라가는 영역

함께 논의할 질문들

내 개발 워크플로에서 에이전트 루프로 옮길 구간은?

CLAUDE.md · Rules · Skills에 무엇을 적을까?

어디까지 자율 실행 허용 · 어디는 사람 승인?

프롬프트 · Skill · Harness를 팀에 어떻게 공유?

들어본 것에서

해본 것으로

좋더라, 별로더라, 이건 되겠네, 저건 안 되겠네 —

직접 경험한 사람의 판단이 필요한 시점

Q & A

질의 · 토론

- 오늘 내용 중 바로 시도해볼 것은?

- 우리 레포에 CLAUDE.md 첫 줄에 뭐라고 쓸까?

- 팀과 공유하고 싶은 한 가지는?

AI 개발 도구 Hands-on · 2026. 4 · 김학민